¿Qué es LangChain? y Detalles Que Necesitas Saber

6 minuto(s)

6 minuto(s)En esta página:

- 1. ¿Qué es LangChain?

- 2. ¿Por qué LangChain es importante?

- 3. Conceptos importantes que debes conocer

- 4. Ecosistema y herramientas asociadas

- 5. ¿Cómo Usar LangChain?

- 6. ¿Que Podemos Crear con LangChain?

- 7. Ventajas, limitaciones y riesgos de LangChain

- 8. Buenas prácticas antes de producción (checklist)

- 9. Errores frecuentes y cómo evitarlos

- 10. Recursos oficiales y lecturas recomendadas

- Conclusión

En el mundo de la Inteligencia Artificial estan apareciendo nuevas herramientas.

Una de ellas es LangChain, que como siempre agilizan el desarrollo de aplicaciones.

En este artículo conocerás Qué es LangChain y todos los detalles que necesitas saber, vamos con ello.

1. ¿Qué es LangChain?

Es un framework open-source para construir aplicaciones y flujos de trabajo con modelos de lenguaje (LLMs). Proporciona abstracciones reutilizables, prompts, chains (cadenas), agents (agentes), tools (herramientas), memory (memoria), conectores a bases vectoriales e integraciones con múltiples proveedores de modelos, además de herramientas para despliegue y observabilidad en su ecosistema (LangServe, LangGraph, LangSmith).

El sitio web oficial de LangChain es: https://langchain.com

2. ¿Por qué LangChain es importante?

En la actualidad es importante por las siguientes razones:

2.1 Orquesta LLMs + datos

Facilita conectar LLMs con fuentes externas (bases de datos, PDFs, APIs, indexes vectoriales) para crear aplicaciones basadas en contexto y conocimiento.

2.2 Ecosistema en expansión

Incluye herramientas para observabilidad y evaluación (LangSmith), orquestación de agentes (LangGraph) y despliegue (LangServe). Esto hace que desde prototipos hasta producción tenga soporte dentro del propio ecosistema.

2.3 Integraciones con muchos proveedores

Puedes usar OpenAI, Google (Gemini/Vertex), Anthropic, Hugging Face, Mistral, proveedores locales (Ollama, vLLM), y más. Esto te permite elegir trade-offs entre coste, latencia y privacidad.

3. Conceptos importantes que debes conocer

LangChain tiene ciertos elementos que lo identifican, esto son:

3.1 Chains (Cadenas)

Una chain es una secuencia reutilizable de pasos (ej.: llamar a un LLM → post-procesar → buscar en vectorstore → combinar respuestas). Son el bloque básico para orquestar lógica.

3.2 Agents (Agentes)

Los agents usan un LLM como motor de razonamiento para decidir qué acción ejecutar (p. ej. llamar a una API, realizar una búsqueda, ejecutar código). Para agentes complejos o multi-agente la recomendación es usar LangGraph (más control, persistencia y orquestación).

3.3 Tools (Herramientas) y Toolkits

Son utilidades que un agente puede invocar: web search, ejecución de SQL, envío de e-mails, llamadas a APIs, scraping, etc. Un toolkit es un conjunto de herramientas agrupadas para un dominio.

3.4 Memory (Memoria)

Permite mantener contexto entre llamadas (conversación, variables de usuario, historial). LangChain ofrece varias implementaciones (memoria en Redis, Zep, Motorhead, stores locales) según necesidades de persistencia y latencia.

3.5 Vectorstores & Retrievers

Para RAG (Retrieval-Augmented Generation o Generación Aumentada por Recuperación), se generan embeddings y se guardan en una base vectorial (FAISS, Milvus, Weaviate, Pinecone, etc.). Un retriever recupera los documentos relevantes para añadir contexto al LLM.

3.6 Prompt Templates

Plantillas reutilizables para prompts (incluyen placeholders para contexto). Fundamental para reproducibilidad y mejores prácticas de prompt engineering.

4. Ecosistema y herramientas asociadas

LangChain cuenta con un ecosistema y herramientas particulares, veamos las más importantes:

4.1 LangSmith

Plataforma de observabilidad, trazabilidad y evaluación (logs, métricas, versiones de prompt, evaluaciones automáticas). Útil cuando subes a producción y necesitas medir calidad y errores.

4.2 LangGraph

Framework de orquestación para agentes stateful y multi-agente; añade tienda de memoria, colas de tareas, y Studio/IDE para depuración de agentes. Recomendado si tu aplicación requiere flujos complejos y control fino.

4.3 LangServe

Facilita desplegar runnables / chains como APIs (FastAPI internamente). Útil para transformar prototipos en endpoints reproducibles.

4.4 LangChain Hub / Integrations

Repositorio y paquetes para integraciones con proveedores y servicios (embeddings, vectorstores, llms, herramientas).

5. ¿Cómo Usar LangChain?

A continuación crearemos un ejemplo base del uso de LangChain con el lenguaje de programación Python.

5.1 Instalación

Instalamos langchain, langchain-openai, faiss-cpu y openai ejecutando el siguiente comando:

|

1 2 3 |

pip install -U langchain langchain-openai faiss-cpu openai |

5.2 Código (Python)

Creamos un archivo llamado app.py y le agregamos el siguiente código:

|

1 2 3 4 5 6 7 8 9 10 11 12 13 14 15 16 17 18 19 20 21 22 23 24 25 26 27 28 29 30 31 |

# Ejemplo base (revisa la versión de tu LangChain) from langchain.chains import create_retrieval_chain from langchain.chains.combine_documents import create_stuff_documents_chain from langchain_core.prompts import ChatPromptTemplate from langchain_openai import ChatOpenAI from langchain.embeddings import OpenAIEmbeddings from langchain.vectorstores import FAISS # 1) Preparar embeddings y vectorstore (ya debes tener documentos chunked) emb = OpenAIEmbeddings() # docs_embeddings = [emb.embed(doc) ...] # generar embeddings de tus documentos # vectorstore = FAISS.from_documents(documents, emb) # ejemplo resumido retriever = vectorstore.as_retriever() # 2) Crear LLM (Chat) llm = ChatOpenAI(model="gpt-4o-mini", temperature=0) # 3) Prompt y chain system_prompt = "Usa el contexto adjudicado para responder de forma concisa..." prompt = ChatPromptTemplate.from_messages( [("system", system_prompt), ("human", "{input}")] ) qa_chain = create_stuff_documents_chain(llm, prompt) chain = create_retrieval_chain(retriever, qa_chain) # 4) Ejecutar out = chain.invoke({"input": "¿Cuál es la política de privacidad para clientes?"}) print(out) |

Es importante mencionar que el método create_retrieval_chain y ciertas APIs han sido migradas/renombradas en versiones recientes.

Consulta la guía de migración en la documentación oficial de LangChain si ves advertencias deprecadas.

5.3 Código (JavaScript)

Podemos usar el siguiente ejemplo mínimo:

|

1 2 3 4 5 6 7 |

import { OpenAI } from "langchain/llms/openai"; const llm = new OpenAI({ openAIApiKey: process.env.OPENAI_API_KEY, model: "gpt-4o-mini" }); const res = await llm.call("Escribe un resumen en 3 líneas sobre qué es el sol."); console.log(res); |

Para RAG (Retrieval-Augmented Generation o Generación Aumentada por Recuperación), en el lenguaje de programación JavaScript se combinan módulos de embeddings, vectorstores (p. ej. Pinecone, Milvus) y retrievers, la documentación de LangChain.js tiene quickstarts para RAG.

6. ¿Que Podemos Crear con LangChain?

A continuación te comparto algunos proyectos reales que puedes crear con LangChain:

- Chatbots con acceso a documentos internos (soporte, knowledge base).

- Sistemas de búsqueda semántica (docs, contratos, artículos).

- Asistentes con acciones: agendar, consultar APIs, ejecutar pipelines.

- Generación y post-edición de código, documentación automática.

- Automatización de tareas empresariales integrando bases de datos y LLMs.

7. Ventajas, limitaciones y riesgos de LangChain

Veamos estos puntos a continuación:

7.1 Ventajas

- Reducción de tiempo de desarrollo para RAG, QA y agentes.

- Portabilidad entre proveedores de modelos.

- Ecosistema (observabilidad, despliegue y orquestación) integrado.

7.2 Limitaciones / Riesgos

- Rápidos cambios y breaking changes: LangChain evoluciona con frecuencia; migraciones pueden requerir ajustes en tu código (releases y pre-releases). Planifica pruebas regulares y CI para actualizaciones.

- Costos y latencia: las llamadas a LLMs (especialmente modelos de alta calidad) tienen coste por token y latencia; arquitectura de caché y batch/streaming ayuda.

- Seguridad / Privacidad: cuidado con datos sensibles enviados a LLMs externos. Considera modelos on-prem o proveedores que garanticen privacidad si manejas información regulada.

- Inyección de prompts & alucinaciones: RAG reduce alucinaciones pero no las elimina; verifica fuentes, devuelve source documents y añade checks/guardrails.

8. Buenas prácticas antes de producción (checklist)

A continuación te comparto algunas buenas prácticas que te serán útiles cuando despliegues tu proyecto de LangChain a producción:

- Añade observabilidad (tracing + métricas), puedes hacerlo con LangSmith u otras alternativas.

- Implementa evaluaciones automáticas (e.g., tests de QA sobre respuestas).

- Registra y versiona prompts (control de cambios).

- No envies datos sensibles a LLMs sin anonimizar o sin SLA/contrato.

- Usa retrievers + chunking + max_context para asegurar que el LLM reciba solo lo necesario.

- Añade rate-limits, retries y circuit breakers en producción.

- Manten pipelines de CI/CD para actualizaciones de LangChain (migraciones).

9. Errores frecuentes y cómo evitarlos

Cuando desarrollas proyectos con LangChain, puedes obtener diferentes errores. A continuación te comparto algunos de ellos y cómo evitarlos:

- Usar demasiados tokens en un prompt, chunk y summarization.

- No controlar versiones de dependencias, usa entornos y pruebas automáticas.

- Asumir que RAG siempre evita alucinaciones, siempre debes mostrar las fuentes y hacer validaciones.

- Subestimar costes, monitoriza el uso y configura límites.

10. Recursos oficiales y lecturas recomendadas

Te dejaré unos recursos para que extiendas tus conocimientos en LangChain:

- Documentación oficial – Introducción y conceptos – (Visitar el artículo)

- Integraciones y proveedores (lista de LLMs / embeddings) – (Visitar el artículo)

- Tutorial RAG & Conversational Retrieval Chains (práctico paso a paso) – (Visitar el artículo)

- LangSmith (observability & evals) – (Visitar el artículo)

- LangGraph (orquestación de agentes) – (Visitar el artículo)

- GitHub Releases / Changelog (para ver cambios y breaking changes) – (Visitar el artículo)

11. FAQ (Preguntas Frecuentes)

Siempre hay dudas sobre LangChain, por ello en esta sección responderé algunas preguntas recurrentes que suelen hacerse los usuarios:

¿LangChain es solo para desarrolladores?

Sí, está pensado para equipos técnicos (librerías en Python/JS). Para usuarios no técnicos existen herramientas con UI que abstraen LangChain.

¿Puedo usar LangChain con modelos locales (on-prem)?

Sí, hay integraciones con Ollama, vLLM, y otros proveedores locales; también se integran embeddings locales y vectorstores.

¿LangChain es gratis?

El framework open-source es gratuito (Apache/MIT según paquete), pero servicios asociados (LangSmith, LangGraph Platform) pueden tener planes de pago; además los proveedores de LLMs cobran por uso.

Conclusión

LangChain es hoy una de las herramientas más completas para construir aplicaciones que combinan LLMs con datos reales: facilita RAG, agentes y despliegue, pero exige disciplina en testing, seguridad y control de cambios.

Si vas a construir un asistente con acceso a documentos o procesos automatizados con LLMs, aprender LangChain y su ecosistema (LangGraph, LangServe, LangSmith) es una inversión que reduce tiempo de integración y acelera despliegue.

Síguenos en las Redes Sociales en donde compartimos más contenido gratis para que crescas como profesional.

También en las categorías, etiquetas, búsquedas y más.

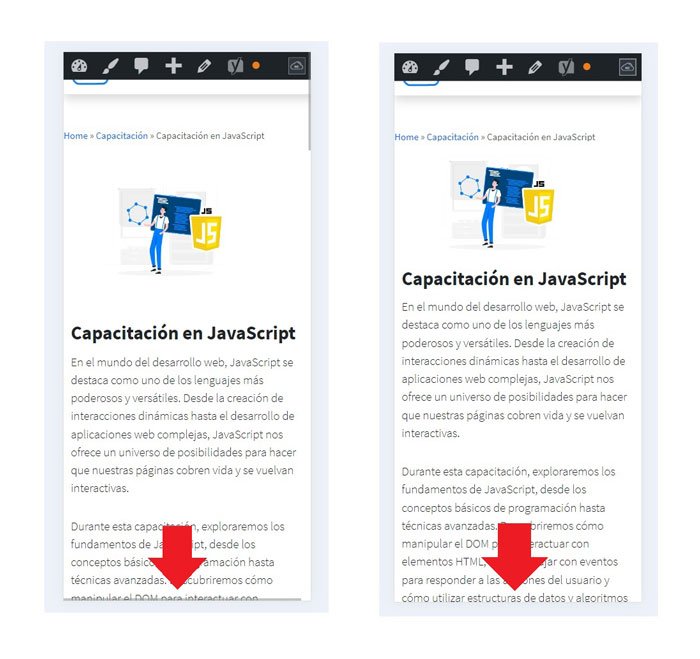

En versiones anteriores, se veian con alto disparejo.

Seguimos trabajando en mejorar la comunidad.

También en las categorías, etiquetas, búsquedas y más.

En versiones anteriores, se veian con alto disparejo.

Seguimos trabajando en mejorar la comunidad.

Seguimos trabajando las 24 horas del día para brindarte la mejor experiencia en la comunidad.

Seguimos trabajando las 24 horas del día para brindarte la mejor experiencia en la comunidad.

Hemos corregido el problema y ahora la web no muestra esa barra horizontal y se ve en su tamaño natural.

Seguimos trabajando las 24 horas del día, para mejorar la comunidad.

Hemos corregido el problema y ahora la web no muestra esa barra horizontal y se ve en su tamaño natural.

Seguimos trabajando las 24 horas del día, para mejorar la comunidad. Seguimos trabajando las 24 horas y 365 días del año para mejorar tu experiencia en la comunidad.

Seguimos trabajando las 24 horas y 365 días del año para mejorar tu experiencia en la comunidad.

Seguimos trabajando para brindarte le mejor experiencia en Nube Colectiva.

Seguimos trabajando para brindarte le mejor experiencia en Nube Colectiva.

Social

Redes Sociales (Developers)

Redes Sociales (Digital)